英伟达GPU交货周期大幅缩短,连锁反应一触即发

从 2023 上半年开始,英伟达的 AI 服务器用 GPU(特别是 H100)就供不应求了,这种状况一直持续到今天。之所以如此,问题出在生产环节,主要涉及台积电的先进制程和封装产能,特别是 CoWoS 封装,市场上具备这种先进封装量产能力的厂商并不多,而台积电没有预料到市场对英伟达 GPU 的需求增长爆发力如此之强,在 2023 年第二季度才开始大规模扩增 CoWoS 产能。

近期,市场传来了一个好消息,瑞银(UBS)的最新报告显示,英伟达大幅缩短了 AI GPU 的交货周期,从 2023 年底的 8~11 个月缩短到了现在的 3-4 个月。这对英伟达客户来说是非常利好的。

01 CoWoS 封装产能是关键

交货时间缩短,表明台积电扩增的 CoWoS 封装产能开始释放。据悉,台积电要在 2024 年底前将相关产能从 2023 年中的水平增加一倍,从目前的情况来看,台积电及其合作伙伴的 CoWoS 产能扩增进展快于预期,使得以 H100 为代表的高性能 GPU 交货时间大幅缩短。

产业人士分析,从 2023 年 7 月到年底,台积电积极调整 CoWoS 封装产能,已逐步扩充并稳定量产,去年 12 月,台积电 CoWoS 月产能增加到 1.4 万 ~1.5 万片。

虽然台积电在积极扩产,但只这一家的产能还是无法满足市场需求,因此,英伟达已经在 2023 年向台积电以外的专业封测代工厂(OSAT)寻求帮助,主要包括日月光和安靠(Amkor),其中,安靠在 2023 年第四季度已开始提供相关产能,日月光投控旗下矽品也于 2024 年第一季度开始供应 CoWoS 封装产能。

2024 年,AI 芯片用先进封装产能依然会供不应求,包括台积电、日月光、安靠、力成、京元电在内的专业封测代工厂,将会在今年扩大资本支出,以布局先进封装产能。

根据台积电的扩产节奏,预计到今年第四季度,该晶圆代工龙头的 CoWoS 月产能将大幅扩充到 3.3 万 ~3.5 万片。

今年,日月光的资本支出规模将同比增长 40%~50%,其中,65% 的投资用于封装,特别是先进封装项目。日月光投控营运长吴田玉表示,今年的先进封装与测试营收占比会更高,AI 相关先进封装收入将翻倍,今年相关营收至少增加 2.5 亿美元。力成也在扩大先进封装产能,该公司董事长蔡笃恭表示,下半年将积极扩大资本支出,规模有望达到 100 亿元新台币。力成主要布局扇出型基板封装(fan out on substrate)技术,整合 ASIC 和 HBM 先进封装,在 AI 用 HBM 内存方面,力成有望在今年第四季度量产相关产品。为满足 CoWoS 封装后的晶圆测试需求,今年,京元电相关晶圆测试产能将扩充两倍。

02 竞争对手雪上加霜

近些年,全球 AI 核心处理器市场几乎被英伟达 GPU 垄断,此次,该公司供货能力进一步提升,对于各家竞争对手来说,真是雪上加霜,有些厂商的日子更难过了,特别是一些对标英伟达产品的创业公司,有的已经接近倒闭。

据 The Information 统计,在北美地区,至少有 12 家 AI 芯片创业公司想从英伟达独享的生成式 AI 算力红利中分一杯羹。在这些创业公司中,创办时间最长的不超过 8 年,有 5 家都是 2022 年创办的,有 4 家创始成员有谷歌背景。

这 12 家 AI 芯片创业公司,有的定位做训练,有的主攻推理,有些则更进一步,将其产品定位瞄准特定类型的 AI 模型。推理一直是更受欢迎的选择,因为很多客户使用或微调已经被训练过的模型,而不是从头开始构建一个新模型。AI 芯片创业公司 d-Matrix、Etched.ai、Extropic、SiMa.ai、Groq 正在构建专门用于某些模型架构的芯片,如为 OpenAI 和 Anthropic 的大语言模型提供动力的 Transformer。这些公司认为,专用芯片比英伟达、Cerebras、Lightmatter、Rain AI、Tenstorrent 等的通用芯片更快、效率更高。

还有几家创业公司正在开发新 GPU 技术和产品,包括专用的 AI 加速器和针对特定应用优化的定制芯片。如果这些创业公司的技术被证明优于老牌企业,他们可能会成为颠覆者,但是,从过去几年的技术和产品发展情况来看,短时间内,要想颠覆英伟达的产品和生态系统,难度非常大,已经有几家公司支撑不住了,由于它们开发的新技术和产品很难在市场上销售出去,导致资金链非常紧张。

以英国的 Graphcore 为例,该公司正在考虑出售给外国买家,据媒报道,Graphcore 一直在与主要科技公司进行谈判,因为它正在寻求资金来弥补日益增长的亏空。2023 年,Graphcore 就曾表示,在销售额下降 46% 且亏损增加后,它需要新的资金。

03 中国市场紧迫感增加

目前,全球 AI 市场用到的 GPU,先进且用量最大的是 H100,但该产品在巨大的中国大陆市场难以实现大规模销售。对于英伟达来说,产能问题的解决,可以实现更多订单,对于中国大陆市场来说,全球市场 GPU 供应量的增加,会进一步增加本土 AI 服务器和应用企业的紧迫感,因为全球 AI 应用水平会随 GPU 供应量的大幅增加而提升进步速度,在类似于 H100 这样的主芯片供应受限的情况下,中国市场必须另谋出路,才能保证本土市场 AI 服务器系统和应用水平不掉队。

在 A800 和 H800 芯片被禁售以后,英伟达又为中国大陆市场提供了新的方案—— H20、L20 和 L2。但是,在目前这种情况下,中国客户是否愿意大规模采用英伟达这些降级版本 AI 芯片呢?

据报道,自 2023 年 11 月以来,阿里巴巴和腾讯等互联网大厂一直在测试英伟达降级版本芯片,这些中国企业已经向英伟达表示,他们计划在 2024 年订购的芯片数量将大大低于他们最初的计划。测试人员强调,与英伟达常规 GPU 相比,需要更多的 H20 芯片来抵消性能差异,从而导致费用大幅增加。基于此,中国本土设计制造的相关芯片对买家更具吸引力,阿里巴巴和腾讯等企业正在将更多订单转移到本土芯片供应商。

这种采购行为的转变在包括百度和字节跳动在内的其它主要芯片买家中也很明显。据 TrendForce 统计,中国云计算公司使用的高端 AI 芯片中,约有 80% 来自英伟达,但这一比例在未来 5 年内可能会下降至 50%~60%。

与此同时,百度和阿里巴巴等中国 CSP 也在积极投资自研 AI 芯片。

百度于 2020 年推出了首款自研的 AI 芯片昆仑芯,并在 2021 年推出第二代,计划在 2024 年推出第三代。在收购中天微并成立 T-Head Semiconductor(平头哥)后,阿里巴巴也开始设计 AI 芯片,代表产品是含光 800。虽然 T-Head 最初与外部公司合作进行 ASIC 芯片设计,但从 2023 年开始,阿里巴巴将主要依赖内部资源来加强其下一代 ASIC 芯片设计,特别是阿里云的 AI 基础设施。

近些年,华为、寒武纪、天数智芯等中国本土企业也在潜心研究高性能 AI 芯片,产品力不断升级。以华为昇腾 910 为例,该款芯片采用 7nm 制程,集成了超 496 亿个晶体管,可以提供 320TFLOPS 的 FP16 计算速度或 640TOPS 的 INT8 算力,略高于英伟达 A100 的 FP16 计算速度(312TFLOPS,不采用英伟达稀疏技术)。

04 AI 服务器生产和代工的商机

从目前的发展情况来看,2024 年,AI 服务器和相关系统将会加快组装、生产和应用节奏,TrendForce 认为,2024 年,全球 AI 服务器数量将超过 160 万台(包含采用高端 GPU 的 AI 训练服务器,以及采用中低端 GPU、FPGA、ASIC 的 AI 推理服务器),同比增长 40%,这将为相关芯片和电子制造代工业务(EMS)带来更多商机,特别是中国台湾和中国大陆相关厂商,有更多可以挖掘的市场空间。

目前,各大云服务提供商正在竞相布局 LLM 与生成式 AI 应用,如 Google 的 Gemini,Amazon 也在训练新的 LLM。预计中小语言模型会是 2024 年新兴竞争领域,许多更为定制化、符合运算效率的模型将陆续出现,例如 Llama-2、Microsoft Phi-2、Google Gemini Nano 2 等。而随着英伟达 GPU 供应能力的提升,这些 AI 应用面市的速度会加快,对相关服务器生产和代工的需求也会提升。

近期,中国台湾 AI 服务器供应链高度关注 AI 芯片供应状况的变化。供应链人士表示,鸿海是英伟达板卡主要供应商,也是 HGX、DGX 等服务器平台供应商,市占率超过 70%,许多产品甚至独家供应。鸿海董事长刘扬伟先前公开表示,鸿海 AI 服务器业务接单状况相当好。

广达同样看好今年 AI 服务器出货,该公司预期,如果 AI 芯片供货缓解,最快 5 月起,AI 服务器出货量将明显提升,下半年将进入出货爆发期,今年 AI 服务器营收增长幅度将达到两位数百分比。

据悉,纬创手握英伟达 CoWoS AI 芯片基板 85% 订单,也是 AMD 和英特尔 AI 芯片模组、基板的独家供应商。纬创表示,今年 AI 相关营收增长幅度将达到三位数百分比。

在中国大陆,AI 服务器出货量也在快速增长。中商产业研究院发布的《2022-2027 年中国服务器行业需求预测及发展趋势前瞻报告》显示,2022 年,AI 服务器市场出货量约 28.4 万台,同比增长 25.66%,2023 年约为 35.4 万台。中商产业研究院分析师预测,2024 年,中国大陆 AI 服务器出货量将达到 42.1 万台。

从全球市场来看,AI 服务器 TOP10 厂商中,中国大陆厂商占据 4 席,其中,浪潮信息是本土最大 AI 服务器厂商。在中国大陆市场,AI 服务器市场集中度较高,排名前三的厂商为浪潮信息、宁畅和华为,这三家的市占率总和达 70.40%。另外,新华三的产品也值得关注。

浪潮的代表产品是 NF5688M6,它是为超大规模数据中心研发的 NVLink AI 服务器,支持 2 个英特尔 Ice Lake CPU 和 8 个英伟达 A800 GPU,单机可提供 5PFlops 的 AI 计算性能。对比核心硬件来看,NF5688M6 采用英伟达中国特供版芯片 A800,在浮点计算能力、显存带宽、显存容量等性能指标上,与先进算力芯片 A100 基本一致,主要差异在于芯片的数据传输速度,约为 A100 的三分之二。

华为的 AI 服务器融合了自研加速卡和英特尔 CPU,代表产品是 Atlas 800 推理服务器系列,旗下有型号 3000、3010、9000 和 9010,其中,3000 基于昇腾 310 芯片,3010 基于英特尔 CPU,9000 基于华为鲲鹏 920 昇腾 910 处理器,9010 基于英特尔 CPU 华为昇腾 910 芯片。产品最高拥有 2.24 PFLOPS FP16 的算力。

新华三的 AI 服务器可覆盖各种训练负载要求,代表产品包括 R4900 G5、R5300 G5、R5500 G5 等,可分别针对不同训练负载要求,满足大小规模的推理 / 训练任务。软件层面,该公司通过新华三傲飞 AI/HPC 融合管理平台,提升 AI 作业效率约 32%。

05 结语

2024 年,无论是 AI 芯片提供商,还是 AI 服务器生产和代工厂商,都将迎来更广阔的商机。

芯片方面,英伟达凭借 AI 用 GPU 的火爆,已经赚得盆满钵满。在制造方面,以台积电为代表的晶圆代工厂和封测厂大力扩增先进封装产能,将在 2024 年得到回报。

在 AI 服务器生产和代工方面,相关厂商更是商机无限。一般来说,通用服务器的价格是几千美金 / 台,AI 服务器的价格则达到 10-15 万美金 / 台,价格提升了将近 20 倍,在供不应求的当下,这么高的售价还不一定能拿到货。

高端 AI 服务器的价格就更夸张了,据悉,搭载英伟达 A800 的 AI 服务器价格已经从 120 万元 / 台涨到了 140 多万元 / 台,搭载 8 个 H800 的 AI 服务器价格已经涨到了 280 万元 / 台。

用户对喜马拉雅的“一台设备一充值”的抱怨引发了网友的吐槽,认为这是一种花式割韭菜行为。

科技热搜 喜马拉雅 天猫精灵 手表 设备 韭菜 新闻 资讯 直播 视频 美图 社区 本地 热点 2023-08-07

“遥遥领先”,一个华为热梗的走红

科技热搜 华为 芯片 余承东 华为mate 雷蒙 新闻 资讯 直播 视频 美图 社区 本地 热点 2023-09-29

华为 Mate 60 Pro DXOMARK 影像测试结果出炉:总分157,位列排行榜第 1 名

科技热搜 华为mate google pixel oppo find x iphone 新闻 资讯 直播 视频 美图 社区 本地 热点 2023-11-17

《繁花》:A先生最后一集终于露脸,为何是宝总的模样?

娱乐热点 导演 a股 李产 股市 陈真 新闻 资讯 直播 视频 美图 社区 本地 热点 2024-01-18

韩国女团大尺度造型惹争议,穿着令人费解,成员还有中国人

娱乐热点 造型 韩国 尺度 中国人 穿着 新闻 资讯 直播 视频 美图 社区 本地 热点 2024-02-04

曾被卖出19万美元高价!这台初代iPhone太猛了

曾被卖出19万美元高价!这台初代iPhone太猛了

热门赛事

苹果首次允许欧盟用户从网站安装应用/雷军称对汽车价格战做好准备/微博上线热搜投诉入口

科技热搜 2024-03-13

在游戏里搞政治正确的幕后黑手,快被外国网友冲烂了。

科技热搜 2024-03-13

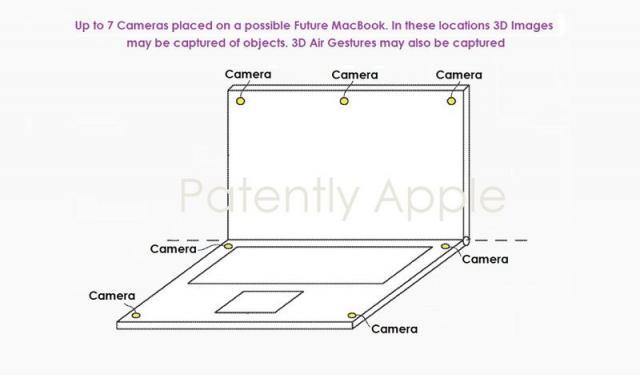

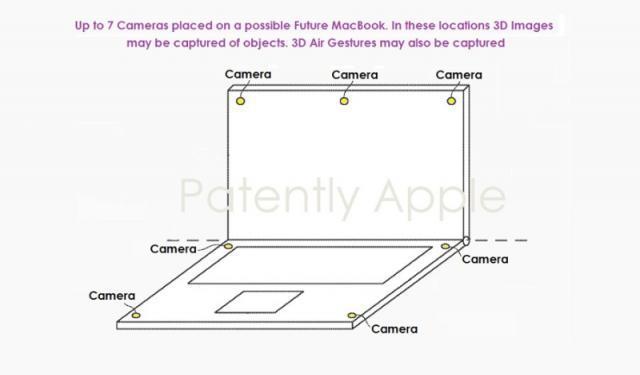

苹果 MacBook 新专利获批:可录制3D 图像/视频、追踪空中手势

科技热搜 2024-03-13

芯片代工营收排行榜公布:台积电独占六成,狂揽近200亿美元

科技热搜 2024-03-13

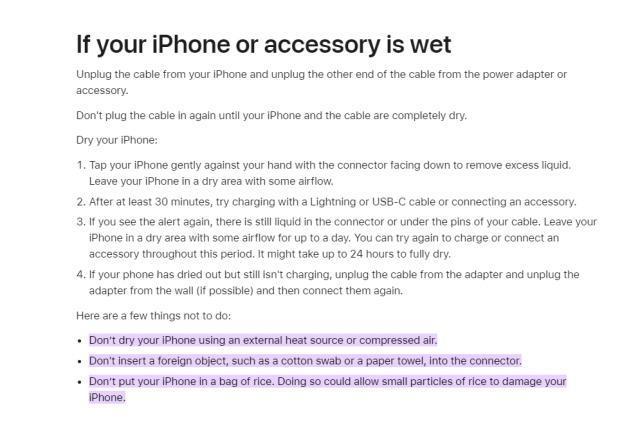

手机进水放米缸?苹果说这招没用。

科技热搜 2024-03-13

TikTok以“美式”反击“美式”

科技热搜 2024-03-13

消息称暴雪国服回归将在一个月内官宣,网易雷火营销/互娱运营

科技热搜 2024-03-13

从“放生”农夫山泉开始,这事算是彻底成互联网闹剧了。

科技热搜 2024-03-13

苹果获得适用于折叠设备和MacBook的摄像头系统专利

科技热搜 2024-03-13

消息称现代汽车将研发5纳米车用半导体,有望由三星、台积电代工

科技热搜 2024-03-13